Begeben wir uns auf eine spannende Reise durch die Geschichte der automatischen Musiktranskription(AMT), die 1897 mit der Erfindung des ersten analogen Oszilloskops durch Karl Ferdinand Braun begann. Ein Oszilloskop ist ein faszinierendes Gerät, das Audio sichtbar macht, indem es Schallwellen als visuelle Wellenformen anzeigt. Diese Technologie war ausschlaggebend für das Verständnis der Struktur und Dynamik des Schalls und ebnete den Weg für zukünftige Fortschritte. Es ermöglichte uns, Musik zu sehen, ein entscheidender Schritt auf dem Weg zur Übersetzung von Audio in schriftliche Notation.

Während wir in die Welt der AMT eintauchen, werden wir erkunden, wie sie sich von diesen frühen Innovationen zu den heutigen hochentwickelten KI-Modellen entwickelt hat. Bist du bereit, die Geheimnisse der Noten auf deinem Bildschirm zu lüften und zu sehen, wie die Technologie sie von bloßen Schallwellen zu den Notenblättern gemacht hat, die wir heute lesen? Lass uns reinspringen!

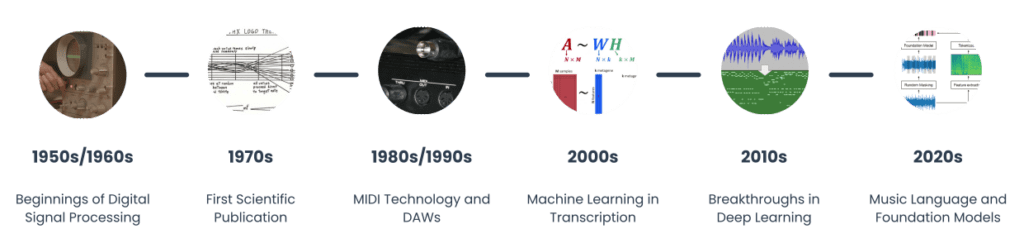

Anfänge der digitalen Signalverarbeitung

Spule zurück in die 1950er/1960er Jahre, eine Ära voller technischer Innovationen, in der die Musik ihre ersten digitalen Schritte machte. Die digitale Signalverarbeitung(DSP) war ein revolutionäres Konzept, das Techniken wie die schnelle Fourier-Transformation (FFT) einsetzte. Stell dir die FFT als einen musikalischen Mathematiker vor, der komplexe Schallwellen geschickt in entzifferbare Daten übersetzt.

Im Jahr 1977 veröffentlichte James A. Moorer die erste wissenschaftliche Arbeit mit dem Titel “On the Transcription of Musical Sound by Computer”(Link). In diesem Beitrag stellt er das Problem der automatischen Musiktranskription vor und liefert einen ersten rudimentären Ansatz, um es zu lösen. Ein kleiner Spaß am Rande: James A. Moorer hat auch das bekannte Deep Note Audio-Logo von THX (der von George Lucas gegründeten Zertifizierungsstelle für Kinos) entworfen.

MIDI und die digitale Revolution

In den lebhaften 1980er/1990er Jahren war der Beginn von MIDI (Musical Instrument Digital Interface) ein Meilenstein in der Musiktechnologie. MIDI revolutionierte die Art und Weise, wie wir mit Musik interagieren, indem es verschiedenen elektronischen Instrumenten und Computern ermöglichte, sich zu verbinden, zu kommunizieren und zu kreieren.

In diese Zeit fällt auch der Aufstieg der digitalen Audio-Workstations(DAWs), die die Musikproduktion zugänglicher und vielseitiger machten. Für Musiker war dies eine goldene Ära der kreativen Befreiung. Stell dir vor, du könntest deine Kompositionen digital orchestrieren und die Essenz deiner musikalischen Gedanken mit Präzision und Leichtigkeit festhalten. MIDI und DAWs haben die Musikproduktion demokratisiert, indem sie Barrieren niedergerissen haben und es Musikerinnen und Musikern aus allen Bereichen ermöglicht haben, zu experimentieren und Musik auf eine Weise zu produzieren, die zuvor unvorstellbar war. Diese Zeit war entscheidend, nicht nur für die Entwicklung der Musiktechnologie, sondern auch für die Art und Weise, wie wir heute Musik schaffen, erleben und teilen.

Das Zeitalter des maschinellen Lernens

Zu Beginn der 2000er Jahre gab es in der AMT-Landschaft einen neuen Akteur: das maschinelle Lernen. Das war nicht nur ein Schritt nach vorne, sondern ein Sprung in eine Zukunft, in der die Technik lernen und sich anpassen kann. Mit den Ansätzen des maschinellen Lernens in der AMT können die Systeme nun ihr Verständnis von Musik auf der Grundlage von Daten verbessern und so die Notenerkennung und Transkriptionsgenauigkeit erhöhen. Stell dir einen intelligenten Assistenten vor, der nicht nur darauf programmiert ist, Regeln zu befolgen, sondern auch in der Lage ist, aus jedem Musikstück, das ihm begegnet, zu lernen. Dieser Durchbruch war für Musiker und Musikbegeisterte gleichermaßen bedeutsam. Es eröffnete Möglichkeiten für genauere und nuanciertere Transkriptionen und ermöglichte eine tiefere Auseinandersetzung mit der Musik. Ganz gleich, ob du eine komplexe Jazzimprovisation oder eine klassische Sonate entschlüsselst, maschinelles Lernen verändert die Art und Weise, wie wir Musik transkribieren und mit ihr interagieren, und macht sie intuitiver und reaktionsschneller.

Der Aufstieg des Deep Learning in der AMT

Die 2010er Jahre läuteten die Ära des Deep Learning ein und brachten die Fähigkeiten des maschinellen Lernens auf ein nie dagewesenes Niveau. Deep-Learning-Modelle mit ihren komplexen neuronalen Netzen begannen, komplexe musikalische Muster und Nuancen wie nie zuvor zu analysieren und zu verstehen. Bei diesem Fortschritt in der AMT ging es nicht nur um die Genauigkeit, sondern auch um die Tiefe und Reichhaltigkeit der Transkription. Für uns Musiker war es so, als hätten wir einen erfahrenen Notenschreiber an unserer Seite, der die Feinheiten von Rhythmus, Melodie und Harmonie bis ins kleinste Detail erfassen konnte. Das hatte tiefgreifende Auswirkungen – es vereinfachte nicht nur den Transkriptionsprozess, sondern eröffnete auch neue Wege für die musikalische Analyse und Kreativität. Deep Learning in AMT ermöglichte es uns, tiefer in die Feinheiten der Musik einzudringen und Kompositionen mit einer Präzision und Einsicht zu verstehen und zu interpretieren, die zuvor unerreichbar war.

Die aktuelle Ära: Musiksprache und Gründungsmodelle

In den 2020er Jahren werden wir Zeugen des Aufkommens von Musiksprachmodellen und Fundamentmodellen, den neuesten Errungenschaften der KI-Musiktranskription. Diese Modelle gehen über die reine Notentranskription hinaus; sie verstehen die emotionalen und stilistischen Nuancen der Musik. Stell dir ein System vor, das nicht nur Noten transkribiert, sondern die Stimmung, das Gefühl und die Essenz eines Stücks einfängt. In dieser Ära geht es darum, die Kluft zwischen menschlicher Kreativität und technologischer Innovation zu überbrücken. Für Musikerinnen und Musiker bedeutet das: Werkzeuge, die nicht nur transkribieren, sondern auch inspirieren und die Kreativität fördern. Diese fortschrittlichen KI-Modelle bieten ein ganzheitlicheres Verständnis von Musik, was sie zu unschätzbaren Verbündeten auf unserer kreativen Reise macht. Sie sind die Spitze dessen, wie Technologie die Kunst der Musik ergänzen und verbessern kann, indem sie uns Einblicke und Möglichkeiten bietet, die unsere musikalischen Erfahrungen und Kreationen bereichern.

Fazit

Von den ersten DSP-Versuchen und den kuriosen Oszilloskopen Mitte des 20. Jahrhunderts bis zu den heutigen fortschrittlichen KI-Modellen ist die Reise von AMT geradezu außergewöhnlich. Es ist eine Erzählung von ständiger Innovation und Entwicklung, in der jedes Kapitel unserem Verständnis und unserer Interaktion mit Musik Tiefe und Dimension verleiht. Für Musikerinnen und Musiker bedeutet die Nutzung dieser Technologien nicht nur, dass sie sich neue Tools aneignen, sondern auch, dass sie